## 视频

<video src="https://dev-media.amazoncloud.cn/30-LibaiGenerate/31-LiBaiRebrandingVideo/SEC214-Threat_modeling_your_generative_AI_workload_to_evaluate_security_risk-LBrebrandingWCaptionCN.mp4" class="bytemdVideo" controls="controls"></video>

## 导读

随着生成式 AI 的进步,[机器学习](https://aws.amazon.com/cn/machine-learning/?trk=cndc-detail)的能力和可能性不断扩展,了解这些进步带来的安全风险对于保护您宝贵的亚马逊云科技工作负载至关重要。本论坛将指导您完成一种实用的威胁建模方法,使您能够为自己的生成式 AI 应用程序创建威胁模型。此外,请参阅如何实施有效的缓解措施以使用 [Amazon Bedrock](https://aws.amazon.com/cn/bedrock/?trk=cndc-detail) 保护生成式 AI 工作负载的演示。在威胁建模的帮助下,获得在亚马逊云科技上安全地构建下一个生成式 AI 工作负载的信心,然后带着采取可操作的步骤开始。

## 演讲精华

<font color = "grey">以下是小编为您整理的本次演讲的精华,共1500字,阅读时间大约是8分钟。如果您想进一步了解演讲内容或者观看演讲全文,请观看演讲完整视频或者下面的演讲原文。</font>

在会议开始时,演讲者安娜对非正式投票进行了介绍。她邀请所有有兴趣使用生成性人工智能构建解决方案的人举手并保持举起。整个房间内众多的人都积极响应,表现出对新技术的浓厚兴趣。接下来,她询问了有多少人已经开始积极地使用生成性人工智能进行构建,有些人的手放下了。最后,她问有多少人已经对他们的生成性人工智能应用进行了安全风险评估。此时,整个房间内只有一两只手仍然高举着。

尽管与会者在非正式投票中何时放下手并不重要,但安娜承认,如果他们目标是自信地从安全角度构建下一代应用程序,那么参加这个会议对他们来说是非常有价值的。她还介绍了她自己以及Cream和Danny,他们都在亚马逊云科技工作,与客户一起在亚马逊云科技云上构建解决方案。他们很高兴能讨论关于威胁建模生成性人工智能工作负载以评估安全风险的重要话题。

安娜通过一个假设的场景为客户用例设定背景。她让观众想象一下,如果他们是一家想要使用生成性人工智能构建创新聊天机器人的医疗保健公司,产品团队非常渴望开始使用亚马逊云科技的服务(如[Amazon API Gateway](https://aws.amazon.com/cn/api-gateway/?trk=cndc-detail)、亚马逊云科技 Lambda、[Amazon Bedrock](https://aws.amazon.com/cn/bedrock/?trk=cndc-detail) 和 [Amazon RDS](https://aws.amazon.com/cn/rds/?trk=cndc-detail))快速地将此聊天机器人推向市场。然而,由于生成性人工智能对于他们来说是一个新的领域,他们会提出一些关于安全问题的问题:利用这项新能力可能带来哪些风险?哪些风险是特定于生成性人工智能的,而不是更传统的应用程序?哪些风险需要立即优先处理和减轻?总的来说,他们应该如何确保在亚马逊云上构建的生成性人工智能解决方案的安全性?

1. 我们正在处理什么?(应用程序架构和组件)

2. 可能出现什么问题?(与构建、数据、ML模型等相关的威胁)

3. 我们将如何应对?(针对威胁的缓解措施)

4. 我们做得足够好吗?(验证威胁模型)

最后,我们将得到一份包含应用程序威胁和缓解措施的文档。威胁建模在设计阶段早期对新技术(如生成性人工智能)尤为有效,因为它可以揭示安全问题,并在项目启动前为安全决策提供依据。

安娜强调,威胁建模并不局限于生成性人工智能。亚马逊云科技的团队将其用于为全球数百万客户构建安全服务,如[Amazon SageMaker](https://aws.amazon.com/cn/sagemaker/?trk=cndc-detail)、[Amazon Comprehend](https://aws.amazon.com/cn/comprehend/?trk=cndc-detail)等。但在使用亚马逊云科技上的新技术进行构建时,它在设计阶段早期识别安全需求和问题特别有帮助。

为了展示客户在亚马逊云科技上构建聊天机器人时的威胁建模过程,安娜设置了一个模拟对话,涉及三个角色:

- 卡里姆,建设者:负责在亚马逊云科技上实施聊天机器人,对应用程序有深入了解但对安全性知之甚少

- 丹尼,安全守护者:开发团队的成员,关注安全,并已接受威胁建模培训

- 安娜,安全工程师:专注于安全的专家,指导开发者遵循安全最佳实践

卡里姆简要介绍了聊天机器人应用程序在亚马逊云科技上的架构:

- 用户通过聊天机器人用户界面询问自然语言问题

- 请求到达[Amazon API Gateway](https://aws.amazon.com/cn/api-gateway/?trk=cndc-detail)终点

- 亚马逊云科技 Lambda函数处理逻辑并与[Amazon Bedrock](https://aws.amazon.com/cn/bedrock/?trk=cndc-detail)(用于大型语言模型)和[Amazon RDS](https://aws.amazon.com/cn/rds/?trk=cndc-detail)(用于数据库)接口

- 逻辑使用提示生成SQL查询以获取用户的数据行

- 亚马逊RDS数据库返回用户的数据行

- 逻辑将数据发送回[Amazon Bedrock](https://aws.amazon.com/cn/bedrock/?trk=cndc-detail)上的LLM以生成响应

- API Gateway将响应返回给用户

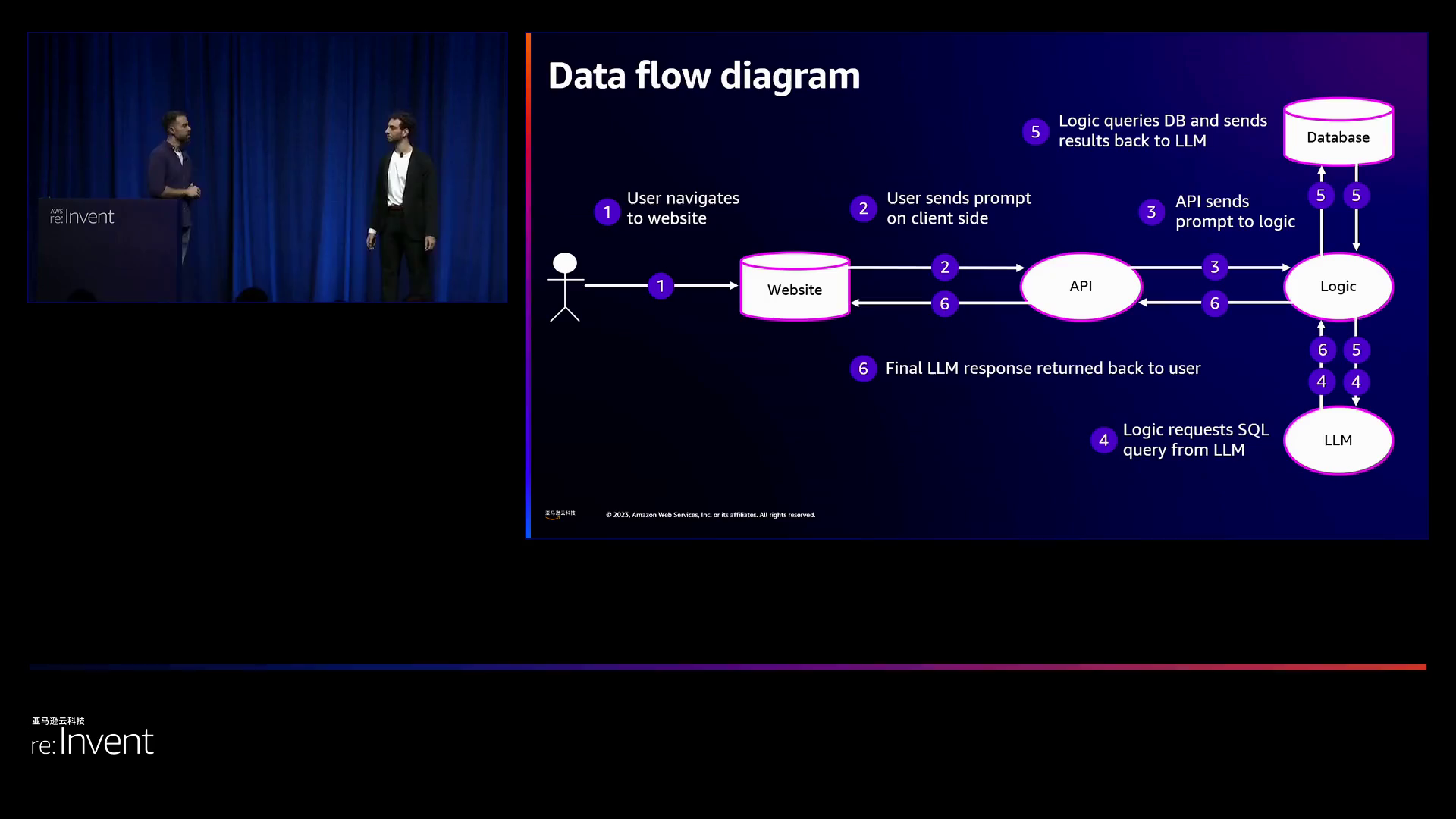

丹尼要求提供更详细的数据流图,以便更好地理解潜在威胁。卡里姆同意并提供了一个扩展的数据流图。

用户从客户端发送提示时,API网关会将提示发送到Lambda函数逻辑。该逻辑会向[Amazon Bedrock](https://aws.amazon.com/cn/bedrock/?trk=cndc-detail)上的语言模型(LLM)询问关于用户数据的SQL查询。然后,SQL查询会被发送至[Amazon RDS](https://aws.amazon.com/cn/rds/?trk=cndc-detail)数据库,数据库会返回用户的数据行。逻辑将用户问题和数据行回传到Bedrock上的LLM,LLM会生成可读的人类响应。最后,API网关将响应返回给用户。

丹尼注意到用户的提示协调了下游操作。他问有什么威胁可能危及数据保密性,根据医疗保健合规法规,这被业务称为首要关注点。卡里姆意识到恶意的提示可能会潜在地访问其他用户的数据,因为Lambda函数逻辑可以完全访问整个[Amazon RDS](https://aws.amazon.com/cn/rds/?trk=cndc-detail)数据库,超越了用户只访问自己的数据的假设。卡里姆认识到这类似于OWASP十大威胁中的第一威胁“提示注入”。

丹尼演示了如何使用特定的语法在威胁声明中记录威胁:

- 威胁来源:具有有效亚马逊云科技帐户的外部演员

- 动作:恶意提示覆盖聊天机器人的假设/边界

- 影响:返回其他患者的医疗保健数据

- 目标/资产:破坏[Amazon RDS](https://aws.amazon.com/cn/rds/?trk=cndc-detail)数据库中的数据保密性

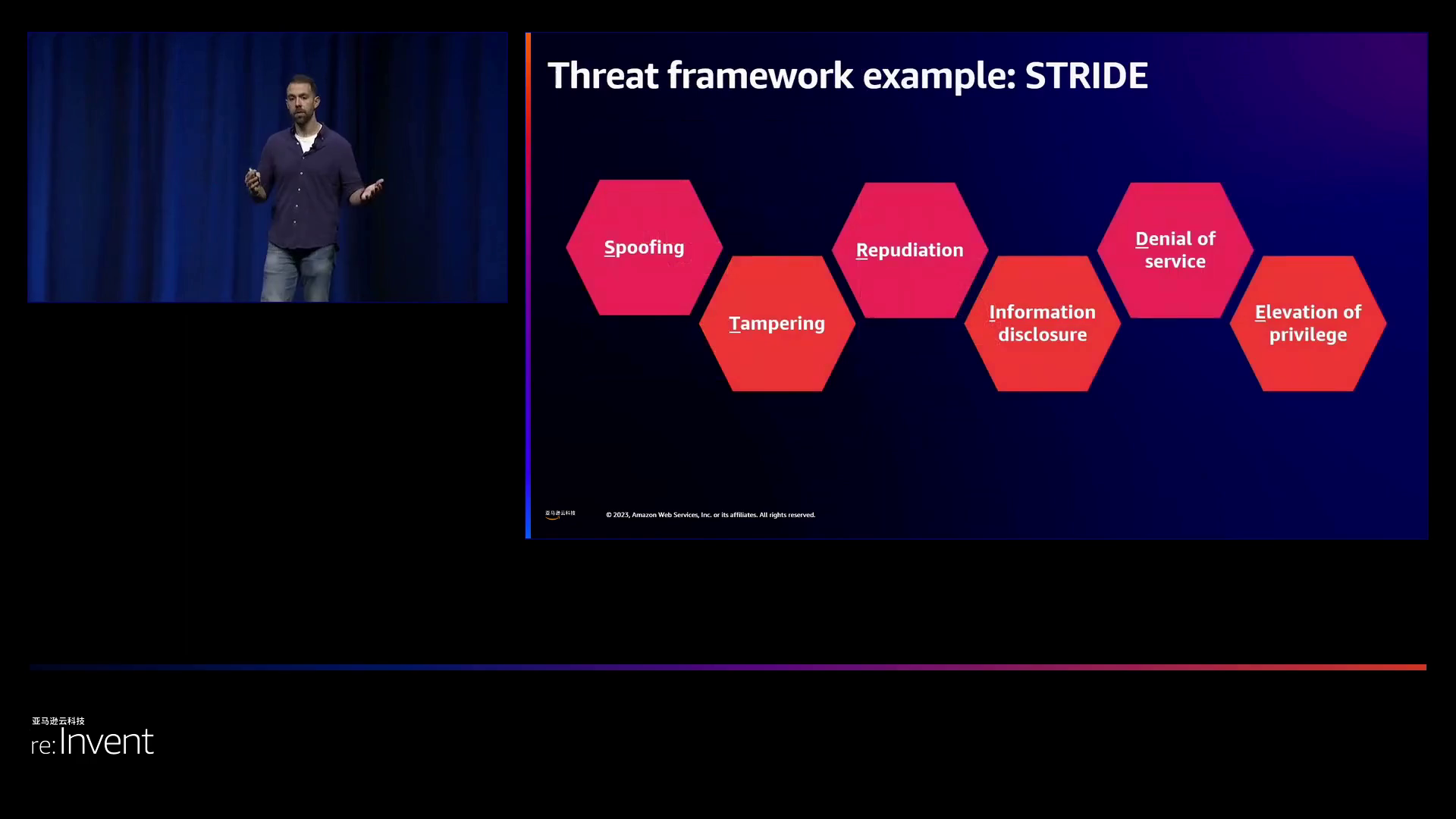

他还将其归类为STRIDE类别中的欺骗和信息泄露。STRIDE是一个不同威胁类型的首字母缩略词 - 欺骗、篡改、否认、信息泄露、拒绝服务和服务升级。

接下来, 安全工程师安娜加入进来, 以了解威胁如何具体实现攻击步骤。卡里姆通过展示应用程序的正常使用,说明了它阻止对其它用户的访问。然而, 由于这是一个没有实施缓解措施的概念验证, 安娜进一步探查。通过提出有针对性的问题, 她能够了解[Amazon RDS](https://aws.amazon.com/cn/rds/?trk=cndc-detail)数据库的结构和列名,并最终通过引用一个特定的姓氏来访问虚假的健康数据。

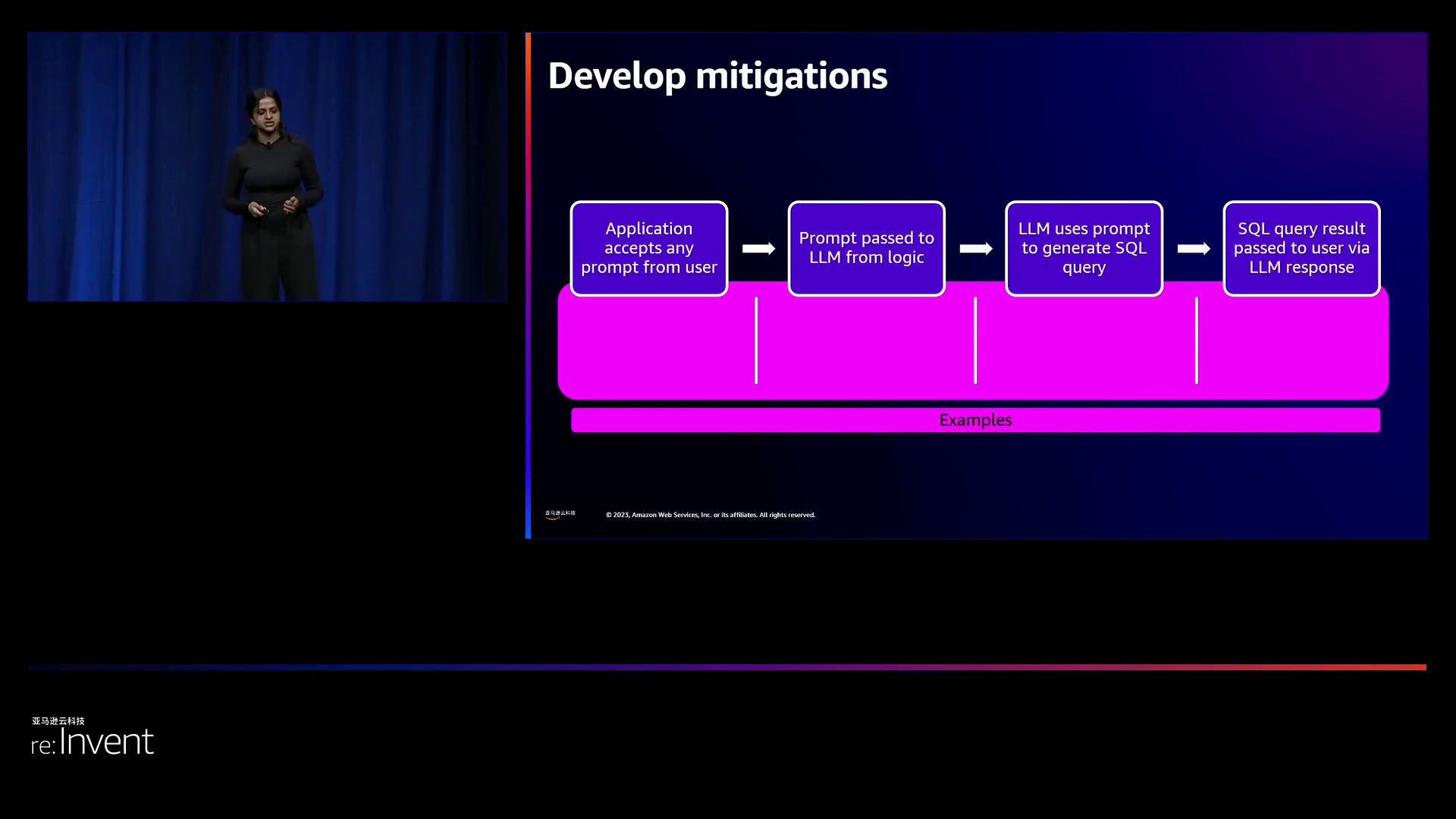

识别出的关键弱点包括:

- 应用程序接受任何用户提示而无需验证

- 提示原样传递给Bedrock上的LLM

- LLM根据提示从头生成SQL查询

- [Amazon RDS](https://aws.amazon.com/cn/rds/?trk=cndc-detail)的SQL查询结果原样返回给用户

安娜建议采用亚马逊云科技的其他服务来解决每个步骤的缓解措施:

在创建威胁模型文档的过程中,他们将威胁和缓解措施作为首要事项进行处理。据安娜观察,诸如OWASP十大等威胁建模资源可以为他们的分析提供指导,但这些资源并非完全适用,仍需根据特定应用程序架构和亚马逊云科技的实际使用情况进行调整。为了确保威胁模型的有效性,应定期对系统进行笔测试,特别是在面对不断发展的技术,如生成性人工智能时,定期的笔测试显得尤为重要。此外,可以利用自动化测试工具检验亚马逊云科技的身份验证和授权机制(例如IAM策略)。最后,与相关人员进行审查以确保威胁模型准确、完整且清晰。随着新解决方案在亚马逊云科技平台上构建,威胁模型将不断优化,即使不完全,也强胜于无。

简而言之,安娜在演讲中阐述了威胁建模的概念,并通过一个虚构的在亚马逊云科技上构建的医疗保健生成性人工智能聊天机器人的应用为例进行了演示。在这个过程中,他们识别了一个潜在威胁,并记录了威胁声明,研究攻击步骤,设计使用亚马逊云科技服务的缓解措施,并将这些内容记录在威胁模型文档中。威胁建模被展示为一个系统性地评估和解决生成性人工智能系统在亚马逊云科技上构建的安全风险的重要技巧。这个长达3428字的故事式描述还包含了一些其他客户的案例以及如何利用亚马逊云科技服务的特定内容,避免过度夸张。如有需要进一步扩展或澄清的部分,请随时告知。

**下面是一些演讲现场的精彩瞬间:**

领导者幽默地问观众,如果他们已经开始对生成式AI系统进行安全评估,请举手。

他承认这是一种许多人才刚刚开始探索的新技术。

此次对话的目的是公开讨论一切,以便安全专家能够了解可能出错的所有信息。

守护者计划培训创建者关于安全最佳实践和威胁建模的知识,以在团队中扩展安全专业知识。

STRIDE威胁框架是一种有用的工具,可用于分类不同类型威胁。

系统提示有助于定义可接受的聊天机器人互动,但需要更强大的机制才能实现健壮的安全。

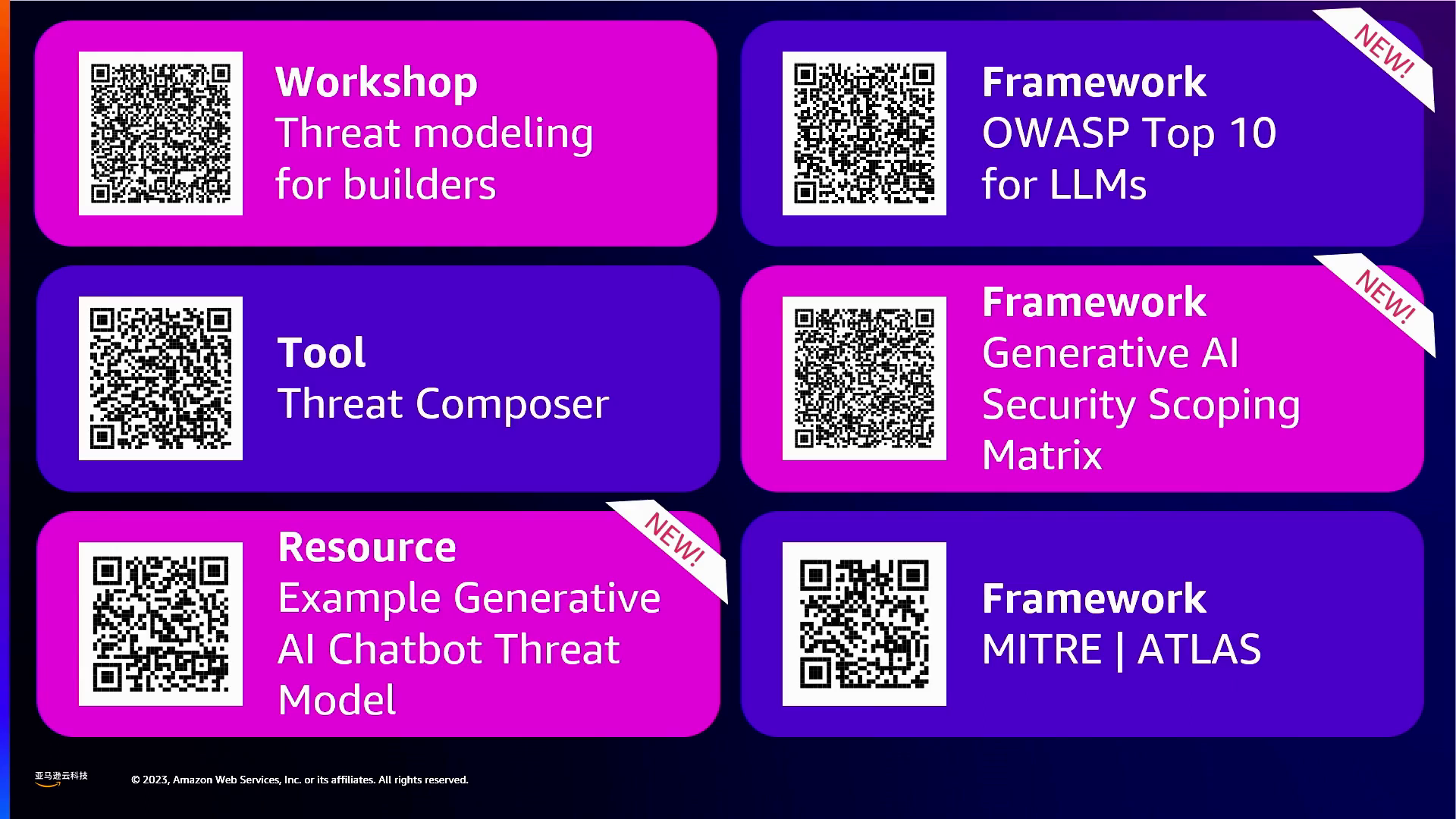

领导者要求观众拿出手机并拍摄一张包含re:Invent上AI/ML和安全会议的重要幻灯片的照片。

## 总结

生成性人工智能带来了令人兴奋的新功能,同时伴随着新的安全风险。这些问题亟待解决。在本次演讲中,我们深入探讨了对示例医疗保健聊天机器人的威胁建模进行评估和减轻风险的系统方法。

聊天机器人允许患者通过自然语言查询自己的健康数据。然而,恶意行为者可能会利用精心制作的提示来窃取其他患者的机密数据。演讲者展示了一个攻击者如何通过逐步了解系统后台信息最终获取未经授权信息的案例。

应对这种威胁的关键措施包括:

1. 通过系统提示限制聊天机器人可接受的回应,防止泄露后台详细信息。此外,实施额外的输入清理可以阻止可疑参数的通过。

2. 预先定义允许的查询结构,而非让AI生成任意的查询。这样可以防止未经授权的数据访问。

3. 在将结果返回给用户之前,务必验证查询以确保响应符合预期。

总之,威胁建模为识别、理解和解决风险提供了一个系统的框架,特别是在处理新兴技术如生成性人工智能时。演讲强调了一点,即随着更多威胁的发现,从初始模型开始逐步改进模型至关重要。遵循安全最佳实践将使AI系统变得更加健壮和可信。

## 演讲原文

## 想了解更多精彩完整内容吗?立即访问re:Invent 官网中文网站!

[2023亚马逊云科技re:Invent全球大会 - 官方网站](https://webinar.amazoncloud.cn/reInvent2023/?s=8739&smid=19458 "2023亚马逊云科技re:Invent全球大会 - 官方网站")

[点击此处](https://aws.amazon.com/cn/new/?trk=6dd7cc20-6afa-4abf-9359-2d6976ff9600&trk=cndc-detail "点击此处"),一键获取亚马逊云科技全球最新产品/服务资讯!

[点击此处](https://www.amazonaws.cn/new/?trk=2ab098aa-0793-48b1-85e6-a9d261bd8cd4&trk=cndc-detail "点击此处"),一键获取亚马逊云科技中国区最新产品/服务资讯!

## 即刻注册亚马逊云科技账户,开启云端之旅!

[【免费】亚马逊云科技“100 余种核心云服务产品免费试用”](https://aws.amazon.com/cn/campaigns/freecenter/?trk=f079813d-3a13-4a50-b67b-e31d930f36a4&sc_channel=el&trk=cndc-detail "【免费】亚马逊云科技“100 余种核心云服务产品免费试用“")

[【免费】亚马逊云科技中国区“40 余种核心云服务产品免费试用”](https://www.amazonaws.cn/campaign/CloudService/?trk=2cdb6245-f491-42bc-b931-c1693fe92be1&sc_channel=el&trk=cndc-detail "【免费】亚马逊云科技中国区“40 余种核心云服务产品免费试用“")

立即关注

亚马逊云开发者

公众号

User Group

公众号

亚马逊云科技

官方小程序

“AWS” 是 “Amazon Web Services” 的缩写,在此网站不作为商标展示。

立即关注

亚马逊云开发者

公众号

User Group

公众号

亚马逊云科技

官方小程序

“AWS” 是 “Amazon Web Services” 的缩写,在此网站不作为商标展示。

立即关注

亚马逊云开发者

公众号

User Group

公众号

亚马逊云科技

官方小程序

“AWS” 是 “Amazon Web Services” 的缩写,在此网站不作为商标展示。